神经网络法如何训练深度神经网络

神经网络法 时间:2021-07-24 阅读:()

目前已有多种神经网络训练方法用

神经网络的学习算法很多 , 根据一种广泛采用的分类方法 , 可将神经网络的学习算法 归纳为 3 类 。一类是有导师学习 , 一类为无导师学习 , 还有一类是灌输式学习 。

~如果你认可我的回答,请及时点击【采纳为满意回答】按钮 ~~手机提问的朋友在客户端右上角评价点【满意】即可。

~你的采纳是我前进的动力 ~~O(∩_∩)O,记得好评和采纳,互相帮助,谢谢。

人工神经网络是怎么学习的呢

1、神经网络的结构(例如2输入3隐节点1输出)建好后,一般就要求神经网络里的权值和阈值。现在一般求解权值和阈值,都是采用梯度下降之类的搜索算法(梯度下降法、牛顿法、列文伯格-马跨特法、狗腿法等等)。

2、这些算法会先初始化一个解,在这个解的基础上,确定一个搜索方向和一个移动步长(各种法算确定方向和步长的方法不同,也就使各种算法适用于解决不同的问题),使初始解根据这个方向和步长移动后,能使目标函数的输出(在神经网络中就是预测误差)下降。

3、然后将它更新为新的解,再继续寻找下一步的移动方向的步长,这样不断的迭代下去,目标函数(神经网络中的预测误差)也不断下降,最终就能找到一个解,使得目标函数(预测误差)比较小。

4、而在寻解过程中,步长太大,就会搜索得不仔细,可能跨过了优秀的解,而步长太小,又会使寻解过程进行得太慢。

因此,步长设置适当非常重要。

5、学习率对原步长(在梯度下降法中就是梯度的长度)作调整,如果学习率lr = 0.1,那么梯度下降法中每次调整的步长就是0.1*梯度, 6、而在matlab神经网络工具箱里的lr,代表的是初始学习率。

因为matlab工具箱为了在寻解不同阶段更智能的选择合适的步长,使用的是可变学习率,它会根据上一次解的调整对目标函数带来的效果来对学习率作调整,再根据学习率决定步长。

什么是神经网络法?

神经网络的介绍2006-10-23 14:58原文摘自:(/alsan/articles/14621.html) Introduction -------------------------------------------------------------------------------- 神经网络是新技术领域中的一个时尚词汇。很多人听过这个词,但很少人真正明白它是什么。

本文的目的是介绍所有关于神经网络的基本包括它的功能、一般结构、相关术语、类型及其应用。

“神经网络”这个词实际是来自于生物学,而我们所指的神经网络正确的名称应该是“人工神经网络(ANNs)”。

在本文,我会同时使用这两个互换的术语。

一个真正的神经网络是由数个至数十亿个被称为神经元的细胞(组成我们大脑的微小细胞)所组成,它们以不同方式连接而型成网络。

人工神经网络就是尝试模拟这种生物学上的体系结构及其操作。

在这里有一个难题:我们对生物学上的神经网络知道的不多!因此,不同类型之间的神经网络体系结构有很大的不同,我们所知道的只是神经元基本的结构。

The neuron -------------------------------------------------------------------------------- 虽然已经确认在我们的大脑中有大约50至500种不同的神经元,但它们大部份都是基于基本神经元的特别细胞。

基本神经元包含有synapses、soma、axon及dendrites。

Synapses负责神经元之间的连接,它们不是直接物理上连接的,而是它们之间有一个很小的空隙允许电子讯号从一个神经元跳到另一个神经元。

然后这些电子讯号会交给soma处理及以其内部电子讯号将处理结果传递给axon。

而axon会将这些讯号分发给dendrites。

最后,dendrites带着这些讯号再交给其它的synapses,再继续下一个循环。

如同生物学上的基本神经元,人工的神经网络也有基本的神经元。

每个神经元有特定数量的输入,也会为每个神经元设定权重(weight)。

权重是对所输入的资料的重要性的一个指标。

然后,神经元会计算出权重合计值 value),而权重合计值就是将所有输入乘以它们的权重的合计。

每个神经元都有它们各自的临界值(threshold),而当权重合计值大于临界值时,神经元会输出1。

相反,则输出0。

最后,输出会被传送给与该神经元连接的其它神经元继续剩余的计算。

Learning -------------------------------------------------------------------------------- 正如上述所写,问题的核心是权重及临界值是该如何设定的呢?世界上有很多不同的训练方式,就如网络类型一样多。

但有些比较出名的包括back-propagation, delta rule及Kohonen训练模式。

由于结构体系的不同,训练的规则也不相同,但大部份的规则可以被分为二大类别 - 监管的及非监管的。

监管方式的训练规则需要“教师”告诉他们特定的输入应该作出怎样的输出。

然后训练规则会调整所有需要的权重值(这是网络中是非常复杂的),而整个过程会重头开始直至数据可以被网络正确的分析出来。

监管方式的训练模式包括有back-propagation及delta rule。

非监管方式的规则无需教师,因为他们所产生的输出会被进一步评估。

Architecture -------------------------------------------------------------------------------- 在神经网络中,遵守明确的规则一词是最“模糊不清”的。

因为有太多不同种类的网络,由简单的布尔网络(Perceptrons),至复杂的自我调整网络(Kohonen),至热动态性网络模型(Boltzmann machines)!而这些,都遵守一个网络体系结构的标准。

一个网络包括有多个神经元“层”,输入层、隐蔽层及输出层。

输入层负责接收输入及分发到隐蔽层(因为用户看不见这些层,所以见做隐蔽层)。

这些隐蔽层负责所需的计算及输出结果给输出层,而用户则可以看到最终结果。

现在,为免混淆,不会在这里更深入的探讨体系结构这一话题。

对于不同神经网络的更多详细资料可以看Generation5 essays 尽管我们讨论过神经元、训练及体系结构,但我们还不清楚神经网络实际做些什么。

The Function of ANNs -------------------------------------------------------------------------------- 神经网络被设计为与图案一起工作 - 它们可以被分为分类式或联想式。

分类式网络可以接受一组数,然后将其分类。

例如ONR程序接受一个数字的影象而输出这个数字。

或者PPDA32程序接受一个坐标而将它分类成A类或B类(类别是由所提供的训练决定的)。

更多实际用途可以看Applications in the Military中的军事雷达,该雷达可以分别出车辆或树。

联想模式接受一组数而输出另一组。

例如HIR程序接受一个‘脏’图像而输出一个它所学过而最接近的一个图像。

联想模式更可应用于复杂的应用程序,如签名、面部、指纹识别等。

The Ups and Downs of Neural Networks -------------------------------------------------------------------------------- 神经网络在这个领域中有很多优点,使得它越来越流行。

它在类型分类/识别方面非常出色。

神经网络可以处理例外及不正常的输入数据,这对于很多系统都很重要(例如雷达及声波定位系统)。

很多神经网络都是模仿生物神经网络的,即是他们仿照大脑的运作方式工作。

神经网络也得助于神经系统科学的发展,使它可以像人类一样准确地辨别物件而有电脑的速度!前途是光明的,但现在... 是的,神经网络也有些不好的地方。

这通常都是因为缺乏足够强大的硬件。

神经网络的力量源自于以并行方式处理资讯,即是同时处理多项数据。

因此,要一个串行的机器模拟并行处理是非常耗时的。

神经网络的另一个问题是对某一个问题构建网络所定义的条件不足 - 有太多因素需要考虑:训练的算法、体系结构、每层的神经元个数、有多少层、数据的表现等,还有其它更多因素。

因此,随着时间越来越重要,大部份公司不可能负担重复的开发神经网络去有效地解决问题。

Conclusion -------------------------------------------------------------------------------- 希望您可以通过本文对神经网络有基本的认识。

Generation5现在有很多关于神经网络的资料可以查阅,包括文章及程序。

我们有Hopfield、perceptrons(2个)网络的例子,及一些back-propagation个案研究。

Glossary -------------------------------------------------------------------------------- NN 神经网络,Neural Network ANNs 人工神经网络,Artificial Neural Networks neurons 神经元 synapses 神经键 works 自我调整网络 networks modelling thermodynamic properties 热动态性网络模型

如何训练深度神经网络

deeplearinig就是神经网络的一类,就是解决的训练问题的深层神经网络,所以你这问题“深度学习会代替神经网络‘就不对,BP么,BP有自己的优势,也是很成熟的算法,做手写识别等等效果已经商用化了,不会被轻易替代。deeplearning远比BP要复杂,用来解决的问题也不是一个层面,所以也没有替代的必要。

Deeplearning所涉及的问题大多数BP都没法解决的。

度学习的概念源于人工神经网络的研究。

含多隐层的多层感知器就是一种深度学习结构,通过组合低层特征形成更加抽象的高层表示属性类别或特征,以发现数据的分布式特征表示。

深度学习的概念由Hinton等人于2006年提出,基于深信度网(DBN)提出非监督贪心逐层训练算法,为解决深层结构相关的优化难题带来希望,随后提出多层自动编码器深层结构。

深度学习是机器学习研究中的一个新的领域,其动机在于建立、模拟人脑进行分析学习的神经网络,它模仿人脑的机制来解释数据,例如图像,声音和文本。

系统地论述了神经网络的基本原理、方法、技术和应用,主要内容包括:神经信息处理的基本原理、感知器、反向传播网络、自组织网络、递归网络、径向基函数网络、核函数方法、神经网络集成、模糊神经网络、概率神经网络、脉冲耦合神经网络、神经场理论、神经元集群以及神经计算机。

每章末附有习题,书末附有详细的参考文献。

神经网络是通过对人脑或生物神经网络的抽象和建模,研究非程序的、适应性的、大脑风格的信息处理的本质和能力。

它以脑科学和认知神经科学的研究成果为基础,拓展智能信息处理的方法,为解决复杂问题和智能控制提供有效的途径,是智能科学和计算智能的重要部分。

- 神经网络法如何训练深度神经网络相关文档

- 神经网络法神经网络算法可以解决的问题有哪些

- 神经网络法Hopfield 神经网络有哪几种训练方法

- 神经网络法什么是人体神经网络?

hostio荷兰10Gbps带宽,10Gbps带宽,€5/月,最低配2G内存+2核+5T流量

成立于2006年的荷兰Access2.IT Group B.V.(可查:VAT: NL853006404B01,CoC: 58365400) 一直运作着主机周边的业务,当前正在对荷兰的高性能AMD平台的VPS进行5折优惠,所有VPS直接砍一半。自有AS208258,vps母鸡配置为Supermicro 1024US-TRT 1U,2*AMD Epyc 7452(64核128线程),16条32G D...

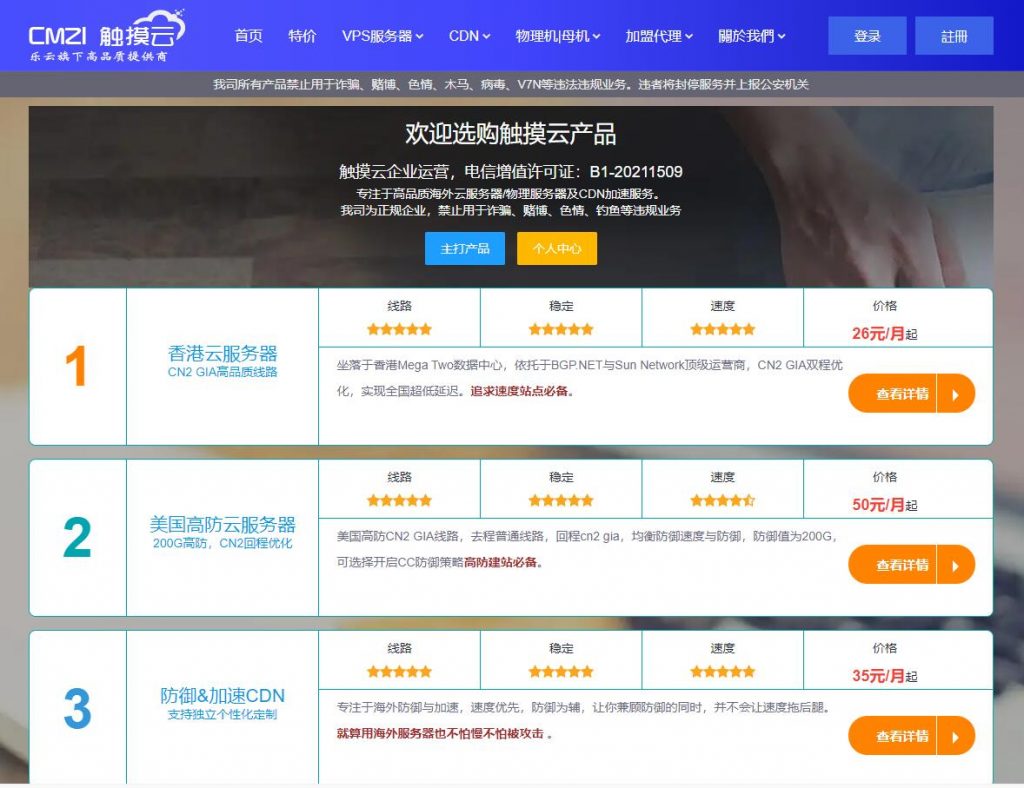

触摸云 26元/月 ,美国200G高防云服务器

触摸云触摸云(cmzi.com),国人商家,有IDC/ISP正规资质,主营香港线路VPS、物理机等产品。本次为大家带上的是美国高防2区的套餐。去程普通线路,回程cn2 gia,均衡防御速度与防御,防御值为200G,无视UDP攻击,可选择性是否开启CC防御策略,超过峰值黑洞1-2小时。最低套餐20M起,多数套餐为50M,适合有防御型建站需求使用。美国高防2区 弹性云[大宽带]· 配置:1-16核· ...

A400互联(49元/月)洛杉矶CN2 GIA+BGP、1Gbps带宽,全场独服永久5折优惠

a400互联是一家成立于2020年商家,主营美国机房的产品,包括BGP线路、CN2 GIA线路的云服务器、独立服务器、高防服务器,接入线路优质,延迟低,稳定性高,额外也还有香港云服务器业务。当前,全场服务器5折,香港VPS7折,洛杉矶VPS5折,限时促销!A400互联官网:https://a400.net/优惠活动全场独服永久5折优惠(续费同价):0722香港VPS七折优惠:0711洛杉矶VPS五...

神经网络法为你推荐

-

发送垃圾短信常见十一类垃圾短信内容windows7正版验证window7正版验证qq申请免费申请qq号免费立即申请垃圾文件清理bat一键清理系统垃圾文件.bat 的原理色中色luntancoreldraw x6怎么抠图换背景dnf客户端消失DNF客户端无缘无故消失人脸检测综述人脸识别技术是怎样实现人脸精准检测?创业好项目论坛谁能提供点真实可靠的,网络创业赚钱项目?智能公共广播系统智能广播的系统内容做视频的免费软件有没有免费做视频的软件 汉化的