访问禁止搜刮引擎收录的方法[教材]

禁止搜索引擎收录的方法

什么是robots.txt文件?

搜索引擎使用spider程序自动访问互联网上的网页并获取网页信息。 spider在访问一个网站时会首先会检查该网站的根域下是否有一个叫做robots. txt的纯文本文件这个文件用于指定spider在您网站上的抓取范围。您可以在您的网站中创建一个robots.txt在文件中声明该网站中不想被搜索引擎收录的部分或者指定搜索引擎只收录特定的部分。

请注意仅当您的网站包含不希望被搜索引擎收录的内容时才需要使用robots. txt文件。如果您希望搜索引擎收录网站上所有内容请勿建立robots.txt文件。

返回页首robots. txt文件放在哪里?robots. txt文件应该放置在网站根目录下。举例来说当spider访问一个网站比如http://www.abc.com时首先会检查该网站中是否存在http://www.abc. com/robots.txt这个文件如果Spider找到这个文件它就会根据这个文件的内容来确定它访问权限的范围。

网站URL相应的robots.txt的URLhttp://www.w3.org/ http://www.w3.org/robots. txthttp://www.w3.org:80/ http://www.w3.org:80/robots. txthttp://www.w3.org: 1234/ http://www.w3.org:1234/robots.txthttp://w3.org/ http://w3.org/robots.txt

返回页首

我在robots. txt中设置了禁止百度收录我网站的内容为何还出现在百度搜索结果中

如果其他网站链接了您robots.txt文件中设置的禁止收录的网页那么这些网页仍然可能会出现在百度的搜索结果中但您的网页上的内容不会被抓取、建入索引和显示百度搜索结果中展示的仅是其他网站对您相关网页的描述。

返回页首

禁止搜索引擎跟踪网页的链接而只对网页建索引

如果您不想搜索引擎追踪此网页上的链接且不传递链接的权重请将此元标记置入网页的<HEA D>部分

<meta name="robots" content="nofollow">

如果您不想百度追踪某一条特定链接百度还支持更精确的控制请将此标记直接写在某条链接上

<a href="signin.php" rel="nofollow">sign in</a>

要允许其他搜索引擎跟踪但仅防止百度跟踪您网页的链接请将此元标记置入网页的<H EAD>部分

<meta name="Baiduspider" content="nofollow">

返回页首

禁止搜索引擎在搜索结果中显示网页快照而只对网页建索引要防止所有搜索引擎显示您网站的快照请将此元标记置入网页的<HEA D>部分

<meta name="robots" content="noarchive">

要允许其他搜索引擎显示快照但仅防止百度显示请使用以下标记<meta name="Baiduspider" content="noarchive">

注此标记只是禁止百度显示该网页的快照百度会继续为网页建索引并在搜索结果中显示网页摘要。

返回页首

我想禁止百度图片搜索收录某些图片该如何设置

禁止Baiduspider抓取网站上所有图片、禁止或允许Baiduspider抓取网站上的某种特定格式的图片文件可以通过设置robots实现请参考“robots. txt文件用法举例”中的例10、 11、 12。

返回页首

我在robots. txt中设置了禁止百度收录我网站的内容为何还出现在百度搜索结果中

如果其他网站链接了您robots.txt文件中设置的禁止收录的网页那么这些网页仍然可能会出现在百度的搜索结果中但您的网页上的内容不会被抓取、建入索引和显示百度搜索结果中展示的仅是其他网站对您相关网页的描述。

返回页首robots. txt文件的格式

"robots.txt"文件包含一条或更多的记录这些记录通过空行分开

以CR,CR/NL, or NL作为结束符每一条记录的格式如下所示"<field>:<optionalspace><value><optionalspace>"。

在该文件中可以使用#进行注解具体使用方法和UN I X中的惯例一样。该文件中的记录通常以一行或多行User-agent开始后面加上若干Disallow和Allow行,详细情况如下

User-agent:

该项的值用于描述搜索引擎robot的名字。在"robots.txt"文件中如果有多条User-agent记录说明有多个robot会受到

"robots.txt"的限制对该文件来说至少要有一条User-agent记录。如果该项的值设为*则对任何robot均有效在"robots.txt"文件中 "User-agent:*"这样的记录只能有一条。如果在

"robots.txt"文件中加入"User-agent:SomeBot"和若干Disallow、Allow行那么名为"SomeBot"只受到"User-agent:SomeBot"后面的Disallow和Allow行的限制。

Disallow:

该项的值用于描述不希望被访问的一组URL这个值可以是一条完整的路径也可以是路径的非空前缀 以Disallow项的值开头的URL不会被robot访问。例如"Disallow:/help"禁止robot访问/help.html、 /helpabc.html、 /help/index.html而

"Disallow:/help/"则允许robot访问/help.html、 /helpabc.html不能访问/help/index.html。 "Disallow:"说明允许robot访问该网站的所有url在"/robots.txt"文件中至少要有一条Disallow记录。如果"/robots.txt"不存在或者为空文件则对于所有的搜索引擎robot该网站都是开放的。

Allow:

该项的值用于描述希望被访问的一组URL与Disallow项相似这个值可以是一条完整的路径也可以是路径的前缀以Allow项的值开头的URL是允许robot访问的。例如"Allow:/hibaidu"允许robot访问/hibaidu.htm、 /hibaiducom.html、 /hibaidu/com.html。一个网站的所有URL默认是Allow的所以Allow通常与Disallow搭配使用实现允许访问一部分网页同时禁止访问其它所有URL的功能。需要特别注意的是Disallow与Al low行的顺序是有意义的 robot会根据第一个匹配成功的Allow或Disallow行确定是否访问某个URL。

使用

Baiduspider支持使用通配符"*"和"$"来模糊匹配url。"$"匹配行结束符。

"*"匹配0或多个任意字符。

返回页首

URL匹配举例

Allow或Di sal low的值URL 匹配结果

/tmp /tmp yes

/tmp /tmp.html yes

/tmp /tmp/a.html yes

/tmp/ /tmp no

/tmp/ /tmphoho no

/tmp/ /tmp/a.html yes

/Hello* /Hello.html yes

/He*lo /Hello, lolo yes

/Heap*lo /Hello, lolo nohtml$ /tmpa.html yes

/a.html$ /a.html yeshtm$ /a.html no

返回页首robots. txt文件用法举例

例1.禁止所有搜索引擎访问网站的任何部分

下载该robots.txt文件 User-agent: *

Disallow: /

例2.允许所有的robot访问

(或者也可以建一个空文件"/robots.txt")

User-agent: *

Disallow:

或者

User-agent: *

Allow: /

例3.仅禁止Baiduspider访问您的网站User-agent: BaiduspiderDisallow: /

例4.仅允许Baiduspider访问您的网站User-agent: BaiduspiderDisallow:

User-agent: *

Disallow: /

例5.禁止spider访问特定目录

在这个例子中该网站有三个目录对搜索引擎的访问做了限制即robot不会访问这三个目录。需要注意的是对每一个目录必须分开声明而不能写成"Disallow: /cgi-bin/ /tmp/"。

User-agent: *

Disallow: /cgi-bin/

Disallow: /tmp/

Disallow: /~joe/

例6.允许访问特定目录中的部分url

User-agent: *

Allow: /cgi-bin/see

Allow: /tmp/hi

Allow: /~joe/look

Disallow: /cgi-bin/

Disallow: /tmp/

Disallow: /~joe/

例7.使用"*"限制访问url

禁止访问/cgi-bin/目录下的所有以".htm"为后缀的URL(包含子目录) 。

User-agent: *

Disallow: /cgi-bin/*.htm

例8.使用"$"限制访问url

仅允许访问以".htm"为后缀的URL。 User-agent: *Allow: .htm$

Disallow: /

例9.禁止访问网站中所有的动态页面

User-agent: *

Disallow: /*?*

例10.禁止Baiduspider抓取网站上所有图片

仅允许抓取网页禁止抓取任何图片。 User-agent:Baiduspider

Disallow: /*. jpg$

Disallow: /*. jpeg$

Disallow: /*.gif$

Disallow: /*.png$

Disallow: /*.bmp$

例11.仅允许Baiduspider抓取网页和.gif格式图片

允许抓取网页和gif格式图片不允许抓取其他格式图片

User-agent: Baiduspider

Allow: /*.gif$

Disallow: /*. jpg$

Disallow: /*. jpeg$

Disallow: /*.png$

Disallow: /*.bmp$

例12.仅禁止Baiduspider抓取. jpg格式图片User-agent:

Baiduspider

Disallow: /*. jpg$

返回页首robots. txt文件参考资料robots. txt文件的更具体设置,请参看以下链接

· Web Server Administrator' s Guide to the Robots ExclusionProtocol

· HTML Author' s Guide to the Robots Exclusion Protocol· The original 1994 protocol description, as currentlydeployed

· The revised Internet-Draft specification, which is not yetcompleted or implemented

HostKvm(4.25美)香港和俄罗斯高防机房云服务器

HostKvm 商家我们算是比较熟悉的国内商家,商家主要还是提供以亚洲数据中心,以及直连海外线路的服务商。这次商家有新增香港和俄罗斯两个机房的高防服务器方案。默认提供30GB防御,且目前半价优惠至4.25美元起步,其他方案的VPS主机还是正常的八折优惠。我们看看优惠活动。香港和俄罗斯半价优惠:2021fall,限购100台。通用优惠码:2021 ,八折优惠全部VPS。我们看看具体的套餐。1、香港高...

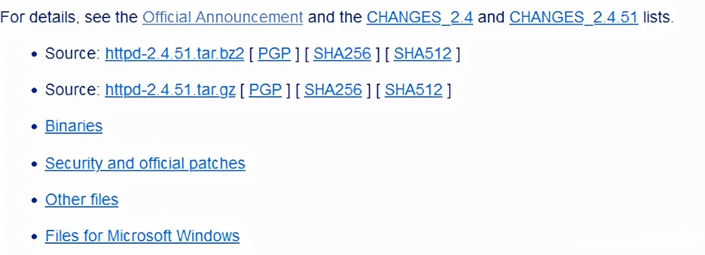

新版本Apache HTTP Server 2.4.51发布更新(有安全漏洞建议升级)

今天中午的时候看到群里网友在讨论新版本的Apache HTTP Server 2.4.51发布且建议更新升级,如果有服务器在使用较早版本的话可能需要升级安全,这次的版本中涉及到安全漏洞的问题。Apache HTTP 中2.4.50的修复补丁CVE-2021-41773 修复不完整,导致新的漏洞CVE-2021-42013。攻击者可以使用由类似别名的指令配置将URL映射到目录外的文件的遍历攻击。这里...

HostKvm($4.25/月)俄罗斯/香港高防VPS

HostKvm又上新了,这次上架了2个线路产品:俄罗斯和香港高防VPS,其中俄罗斯经测试电信CN2线路,而香港高防VPS提供30Gbps攻击防御。HostKvm是一家成立于2013年的国外主机服务商,主要提供基于KVM架构的VPS主机,可选数据中心包括日本、新加坡、韩国、美国、中国香港等多个地区机房,均为国内直连或优化线路,延迟较低,适合建站或者远程办公等。俄罗斯VPSCPU:1core内存:2G...

-

sns平台SNS分类及代表性网站有哪些360退出北京时间utc+8 13:30-14:00换成北京时间是什么时候重庆400年老树穿楼生长重庆海拔500左右的红沙土适合栽哪种果树购物车在超市、商场中为什么需要使用购物车呢?银花珠树晓来看关于下雪景的诗句三五互联南京最专业的网站建设公司是哪家?双尚网络做的好不好? 给分求答案三五互联股票三五互联是干什么的?中国保健养猪网最具权威的养猪信息网站是哪个 啊店铺统计怎样查淘宝店铺的销售总额帖子标题百度贴吧如何改帖子的标题